Alcuni informatori interni di Facebook hanno portato alla luce un meccanismo di censura del social network sugli scettici sul vaccino Covid-19.

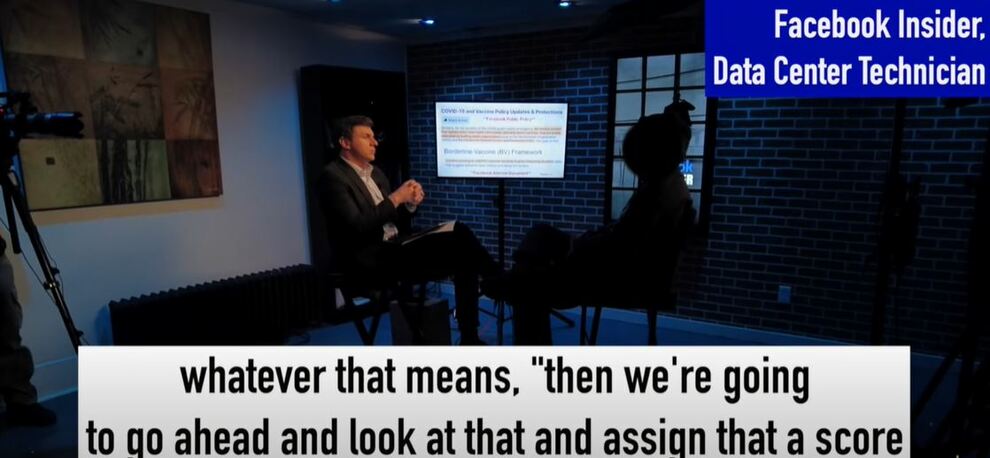

"Vaccine Hesitancy Comment Demotion" è il nome di uno dei documenti trapelati nel nuovo rapporto di Project Veritas, un gruppo di attivisti americani di destra. Il documento mostra come l'obiettivo "l'obiettivo" di Facebook sia quello di «ridurre drasticamente l'esposizione dell'utente all'esitazione del vaccino». Un secondo documento trapelato, riferisce FoxNews, riguarda invece il "Borderline Vaccine Framework (BV) Framework", un meccanismo che stabilisce la classificazione delle pubblicazioni con un altro "obiettivo", quello di «identificare e classificare le categorie di contenuti che potrebbero scoraggiare la vaccinazione in determinati contesti, contribuendo in tal modo a esitazione o rifiuto del vaccino».

Facebook whistleblowers leak documents revealing effort to censor 'vaccine hesitancy': report https://t.co/Lc7YGyLI7w

— Fox News (@FoxNews) May 25, 2021

Criptovalute di nuovo in recupero dopo il tracollo domenicale

«Facebook utilizza classificatori nei propri algoritmi per etichettare determinati contenuti ... lo chiamano "esitazione vaccinale". E all'insaputa dell'utente, assegnano un punteggio a questi commenti chiamato "Punteggio VH", "Punteggio di esitazione del vaccino"», «e poi, in base a quel punteggio, declasseranno o lascieranno il commento», ha rivelato un interno di Facebook al fondatore di Project Veritas, James O'Keefe. L'insider, descritto come un "tecnico del data center" di Facebook, ha rivelato inoltre che il "test" di questo algoritmo sarebbe stato effettuato già sull'1,5% dei suoi 3,8 miliardi di utenti.

«Stanno cercando di controllare il contenuto prima ancora che arrivi sulla tua pagina, prima ancora che tu lo veda», ha detto l'informatore a O'Keefe. Le classificazioni attribuite dall'algoritmo sono di due livelli, una è di "Allarmismo e critica" e l'altra di "Scoraggiamento indiretto ai vaccini" che include il rifiuto del vaccino e "storie scioccanti" che possono dissuadere altri dal sottoporsi all'immunizzazione. Secondo tale meccanismo l'algoritmo contrassegna i termini chiave nei commenti per determinare la possibilità di essere visualizzati. Un secondo informatore descritto come un "Data Center Facility Engineer" ha paragonato la relazione tra Facebook e gli utenti ad una relazione in cui «non si consente al coniuge di parlare delle cose che stanno accadendo nel matrimonio limitando la sua voce».

Facebook 'tried to censor posts about vaccine hesitancy' according to internal memos leaked by whistleblowers https://t.co/M6KgX7EfuU

— Daily Mail Online (@MailOnline) May 25, 2021

Facebook, in una risposta (non immediata) ai documenti trapelati, ha dichiarato a Project Veritas: «Abbiamo annunciato in modo proattivo questa politica sul nostro blog aziendale e abbiamo anche aggiornato il nostro centro assistenza con queste informazioni».